GAN介绍 - 介绍

翻译前言

首先特别感谢Ian Goodfellow先生对此翻译工作的许可与支持。 学习此资料, 可以帮助我们更好的了解GAN的相关基础知识。 对于要学习GAN,以及打算使用GAN做进一步工作的同学,此资料是很有价值的。

此材料是根据Goodfellow先生二个小时演讲的内容而整理制作的,所以对有些内容的描述不够全面。 关于更多信息可以参考相关论文。

此材料主要包含有以下几个方面的内容:

- 为什么需要学习生成式建模?

- 生成式模型是如何工作的? GAN与其他生成式模型有什么区别?

- GAN是如何工作的?

- 提示与技巧

- GAN的相关研究课题

- 即插即用生成模型

- 练习题

- 练习题解答

- 结论

介绍

这个报告总结了在2016年NIPS大会上做的关于对抗式生成式模型(GAN)辅导的内容(Goodfellow et al., 2014b)。 为了让此辅导尽可能的对听众有意义, 此辅导主要内容将主要回答前期读者经常提问的问题。 此辅导不是针对GAN的研究领域进行完整的回顾, 有很多优秀的工作没有在这里介绍,主要是因为他们不是针对回答那些经常被问到的问题, 另外这只是一个两个小时的口头演讲,在有限的时间里也不可能介绍所有的内容。

此辅导将介绍: (1) 为什么生成式模型是一个值得研究的题目, (2) 生成式模型是如何工作的, 以及GAN与其他生成式模型的区别, (3) 详细介绍GAN是如何工作的, (4) GAN的相关研究课题, (5) 当前最先进的整合GAN与其他方法的图像模型。 最后, 此辅导为读者准备了三个练习题以及其答案。

此辅导的幻灯片资料可以在以下URL下载: http://www.iangoodfellow.com/slides/2016-12-04-NIPS.pdf http://www.iangoodfellow.com/slides/2016-12-04-NIPS.key

演讲的视频也已经被公开: https://channel9.msdn.com/Events/Neural-Information-Processing-Systems-Conference/Neural-Information-Processing-Systems-Conference-NIPS-2016/Generative-Adversarial-Networks

从分类上来说,GAN属于生成式模型。 生成式模型有很多的不同的应用方式, 此处的生成式模型指的是用某种方式去学习并表达针对一个训练数据集分布的估计,也就是 \(p_{model}\), 因为对于一个训练数据集来说,它所包含的样本会满足一定的分布 \(p_{data}\)。

有的情况下, 模型的目的是去显式的估计\(p_{model}\),比如图1。 还有的情况下, 模型只能通过 \(p_{model}\) 来产生样本,如图2。 还有模型可以兼而有之。 GAN主要针对样本生成,尽管也可以设计GAN去做此两者。

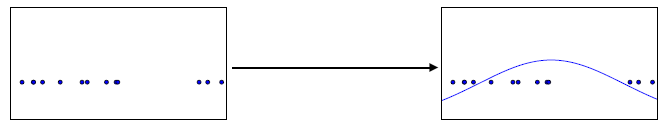

图1: 有些生成式模型通过密度估计。 这类模型通过从未知的数据分布 \(p_{data}\) 生成数据来获取更多的训练数据样本, 并且得到对此未知分布的估计。 通常情况下, 我们不可能知道真实的数据分布 \(p_{data}(x)\), 只能通过一些特殊的样本 \(x\) 来得到一个对真实数据密度的一个估计, 也就是 \(p_{model}\)。 此图展示了一个一维的数据和一个针对此数据分布的高斯模型。

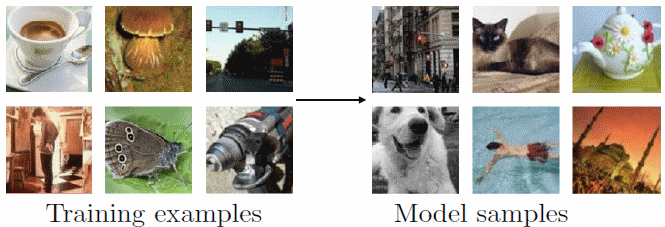

图2: 一些生成式模型可以通过模型的分布来产生样本。 此图展示了ImageNet的样本。 理想的情况下,生成式模型可以使用左边的样本进行训练, 然后产生更多的相同分布的样本 (见右边)。 (由于当前的生成式模型还不能很好的完成对ImageNet样本的生成,此图中右边的样本使用了真实的ImageNet样本来说明此方法。)

[最终修改于: 2017年6月7日]